El proceso de un nuevo estándar tecnológico puede tardar mucho tiempo en ser desarrollado, por poner un ejemplo, el trabajo sobre la memoria DDR4 se inició en 2005, un par de años antes de la comercialización de la memoria DDR3, por lo que no viene como una gran sorpresa que el trabajo en memoria de alto ancho de banda (HBM) comenzara hace mucho tiempo. KitGuru ha escrito un interesante artículo sobre cómo HBM llegó a ser, y cómo este nuevo estándar de la industria fue concebido por primera vez en ATI / AMD algún momento alrededor de 2006 a 2007. Se espera que HBM recoja el legado de GDDR, pudiendo entregar tarjetas gráficas con memorias con 2 TB por segundo de ancho de banda de memoria o de 4 TB por segundo en los próximos 5-7 años.

Entre 2006 y 2007, cuando el trabajo en el procesador gráfico ATI R600 con bus de memoria de 512 bits, así como en el de las tecnologías de memoria GDDR5 GDDR4 y fue esencialmente completado, se hizo evidente que la memoria ya consumía mucha energía, y que consumiría incluso más con el tiempo. Desde que ATI y Nvidia planearon usar sus tarjetas gráficas para aplicaciones de computación de alto rendimiento (HPC), que requieren una gran cantidad de memoria local, era obvio que el consumo de energía de GDDR iba a convertirse en un problema.

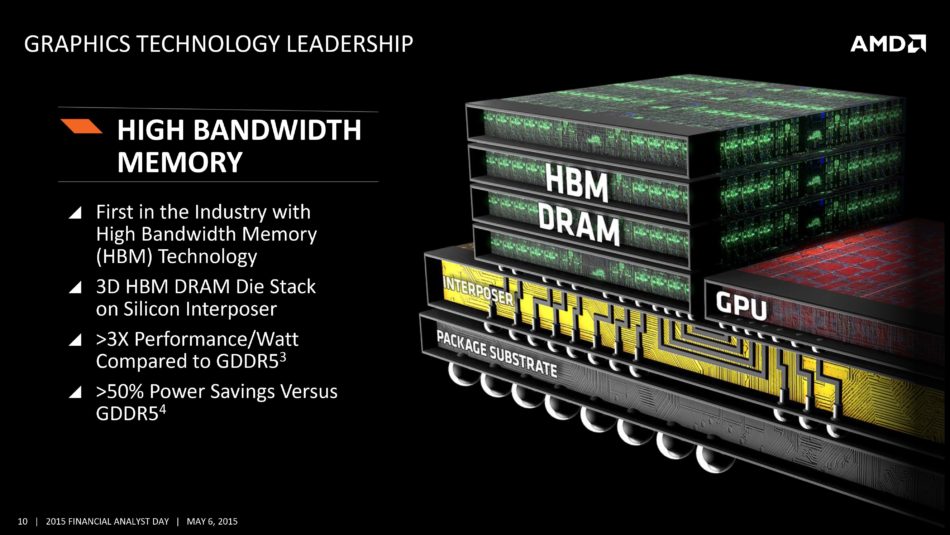

En ese preciso momento, el nuevo equipo de desarrollo de tecnología memoria de ATI Technologies liderados por Joe Macri se le ocurrió una idea para una nueva tecnología de memoria, la cual podría proporcionar un ancho de banda extremo mientras que a su vez consume una pequeña cantidad de energía. Los elementos clave de la nueva tecnología eran chips de memoria de varias capas con una interfaz con un gran ancho de banda que usara silicio de interposición para conectarse a un dispositivo de procesamiento.

De esa forma, y hasta casi 10 años después, es como la ahora AMD, empezó el desarrollo de la memoria de alto ancho de banda, llamada HBM.